LLMs-from-scratch 项目评测报告

🏆 核心结论(先看这里!)

推荐指数:⭐⭐⭐⭐⭐ (5/5)

一句话总结

从零构建大语言模型的最系统学习资源,书籍+代码+视频+练习全覆盖。

核心价值

✅ 系统性教学 - 从数据处理到微调完整流程,循序渐进

✅ 配套丰富 - 配套书籍 + 17小时视频 + 170页练习册

✅ 最新架构 - 涵盖 GQA, MLA, MoE 等前沿技术

📸 产品展示

书籍封面

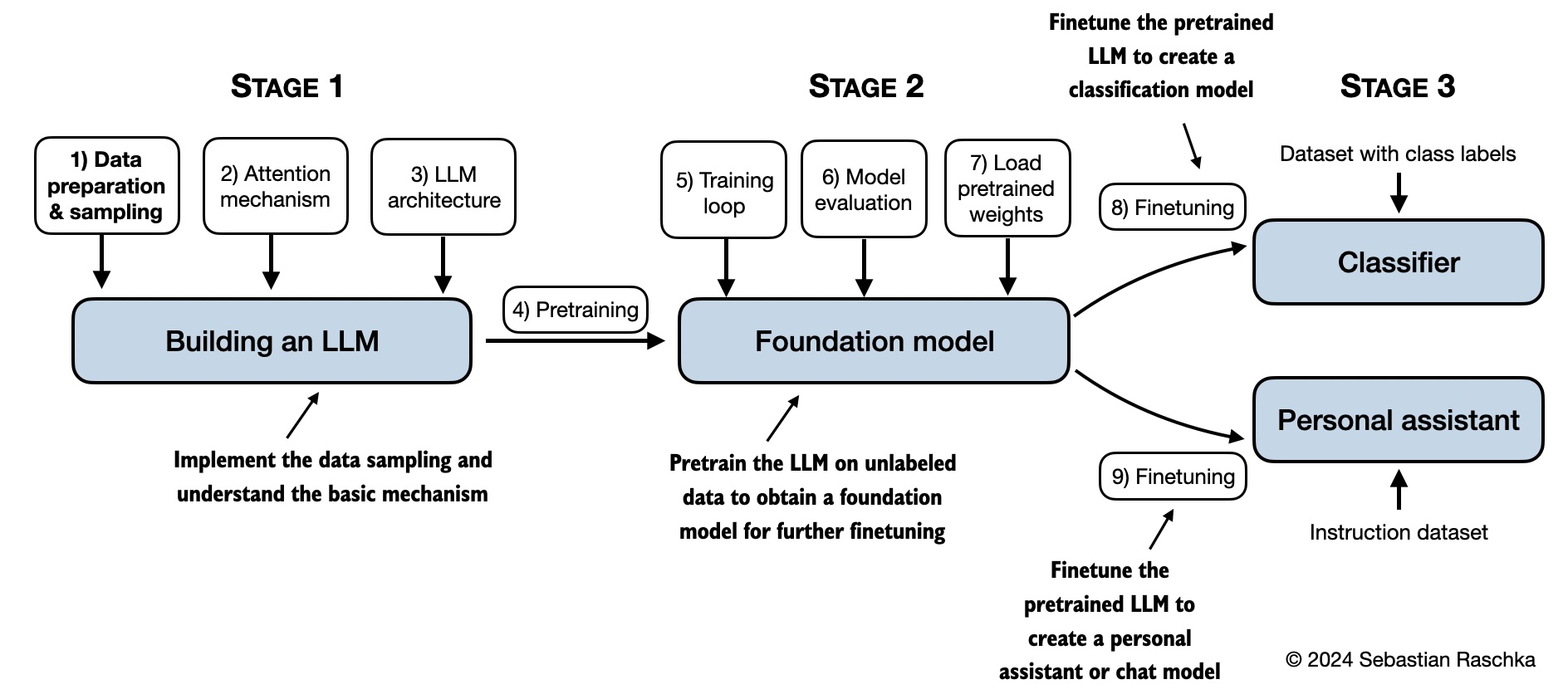

学习路径概览

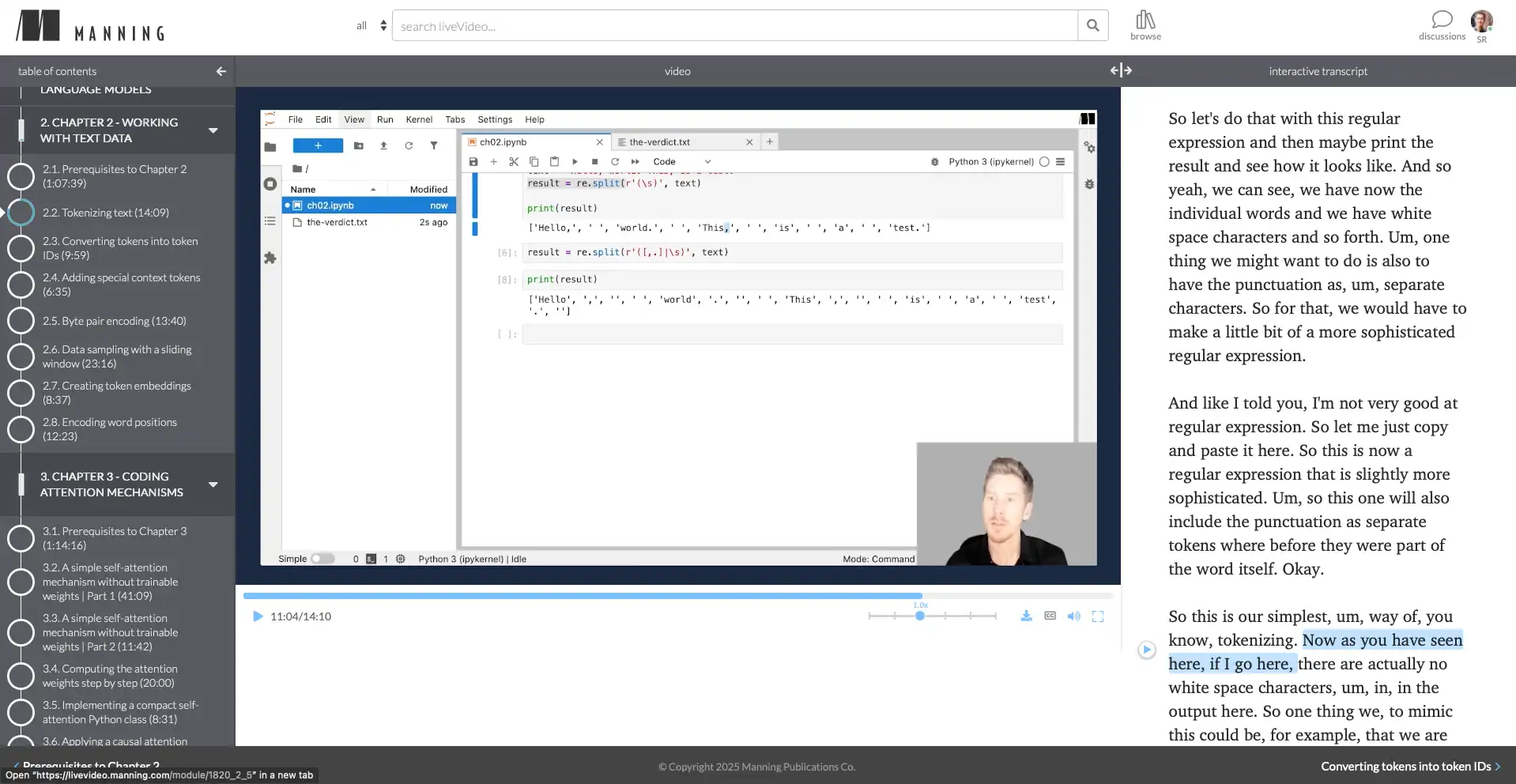

配套视频课程

练习册封面

📌 基本信息

| 项目 | 信息 |

|---|---|

| GitHub | rasbt/LLMs-from-scratch |

| Stars | 88.7k |

| License | 自定义 (配套书籍) |

| 语言 | Python (24.4%), Jupyter Notebook (75.6%) |

| 作者 | Sebastian Raschka |

| 分类 | education |

🎯 核心特性

1. 完整的 LLM 学习路径

7个核心章节覆盖从零构建 LLM 的全流程:

- Ch 1-2: 理解 LLM + 文本数据处理

- Ch 3: 注意力机制实现

- Ch 4: GPT 模型架构

- Ch 5: 无标签数据预训练

- Ch 6-7: 分类/指令微调

2. 丰富的配套资源

- 书籍: Manning 出版,ISBN 978-1633437166

- 视频: 17小时15分钟配套课程

- 练习: 170页练习册(免费下载)

- 续作: Build A Reasoning Model (From Scratch)

3. 前沿技术覆盖

额外材料包含:

- Grouped-Query Attention (GQA)

- Multi-Head Latent Attention (MLA)

- Mixture-of-Experts (MoE)

- LoRA 高效微调

- 多模型支持: Llama 3.2, Qwen3, Gemma 3, Olmo 3

🏗️ 技术架构

目录结构

LLMs-from-scratch/

├ ch02.ipynb # 文本数据处理

├ ch03.ipynb # 注意力机制

├ ch04.ipynb # GPT 模型实现

├ ch05.ipynb # 预训练

├ ch06.ipynb # 分类微调

├ ch07.ipynb # 指令微调

└ appendix-E/ # LoRA 高效微调核心模块

- 数据处理: BPE 分词、滑动窗口采样

- 注意力机制: 多头注意力、因果掩码

- 模型架构: Transformer Block、Layer Norm

- 训练流程: 预训练、微调、DPO 对齐

💡 安装与使用

环境要求

- Python 3.8+

- PyTorch 2.0+

- 普通笔记本即可运行(可选 GPU 加速)

快速上手(5分钟)

bash

git clone --depth 1 https://github.com/rasbt/LLMs-from-scratch.git

cd LLMs-from-scratch

pip install -r requirements.txt

# 或使用 pixi (推荐)

pixi install学习曲线:完整学习需 2-4 周,需要 Python 基础

使用示例

python

# 运行 Jupyter Notebook 学习

jupyter notebook ch02.ipynb # 从文本处理开始🎯 竞争优势对比

vs. Andrej Karpathy nanoGPT

- ✅ 更系统化、教育性更强

- ✅ 配套书籍 + 视频 + 练习

- ❌ nanoGPT 更偏工程实现

vs. Hugging Face Transformers

- ✅ 教你从零实现,理解原理

- ✅ 不是当作黑盒使用

- ❌ HF 更适合快速应用

vs. The Little Book of Deep Learning

- ✅ 有完整代码和视频

- ✅ 更适合实践

- ❌ 书籍需要购买

🎯 适用场景

✅ 推荐场景

- ML 工程师 - 想深入理解 LLM 内部原理

- AI 研究员 - 需要 LLM 实现基础做研究

- 学生/教育者 - 学习或教授深度学习/NLP

- 自学者 - 对 AI 感兴趣且有 Python 基础的开发者

❌ 不适合场景

- 零基础学习者 - 需要扎实的 Python 基础

- 快速应用需求 - 想快速使用 LLM(建议用 Hugging Face)

- 生产部署 - 需要生产级模型(建议用预训练模型)

✅ 优势

- 系统全面: 从数据处理到微调完整流程

- 配套丰富: 书籍 + 17小时视频 + 170页练习

- 代码清晰: Jupyter Notebook 交互式学习

- 无需特殊硬件: 普通笔记本即可运行

- 最新架构: 包含 GQA, MLA, MoE 等前沿技术

- 社区活跃: 88.7k stars, 59 contributors, 持续更新

❌ 不足

- 需要书籍: 代码配合书籍效果最佳(需购买)

- 时间投入: 完整学习需要较长时间

- 前置要求: 需要扎实的 Python 和 PyTorch 基础

- 框架单一: 仅使用 PyTorch,不涉及其他框架

- 模型较小: 教学用小模型,非生产级

🌐 社区活跃度

| 指标 | 数据 |

|---|---|

| Stars | 88.7k |

| Forks | 13.5k |

| Contributors | 59 |

| Commits | 1,037 |

| Issues | 4 |

| PRs | 1 |

| 最后更新 | 持续更新 |

📊 综合评分

| 维度 | 评分 | 说明 |

|---|---|---|

| 技术创新性 | 9.0/10 | 系统化教学创新,非技术突破 |

| 易用性 | 9.5/10 | Jupyter Notebook 交互式学习 |

| 性能表现 | 8.5/10 | 代码优化,支持 GPU |

| 功能完整性 | 9.5/10 | 从数据处理到微调全覆盖 |

| 代码质量 | 9.5/10 | 代码清晰,注释详细 |

| 文档完善度 | 10.0/10 | 书籍 + 17小时视频 + 170页练习 |

| 社区活跃度 | 10.0/10 | 88.7k stars, 59 contributors |

| 可扩展性 | 9.0/10 | 多种架构支持,易于扩展 |

| 商业价值 | 9.0/10 | 教育、培训、研究价值高 |

总体评分:9.3/10.0 ⭐⭐⭐⭐⭐

📌 推荐建议

如果你想真正理解大语言模型如何工作,这是目前最好的学习资源。建议购买配套书籍,配合视频和练习使用,按照章节顺序循序渐进学习。完整掌握需要 2-4 周时间,但物超所值。

评测时间: 2026-03-19

评测版本: v1.2